I più grandi dirigenti tecnologici americani hanno chiesto una rigorosa regolamentazione dell’intelligenza artificiale (Ai) e l’imprenditore Elon Musk ha avvertito che una tecnologia senza controllo rappresenta un «rischio di civiltà» per gli esseri umani.

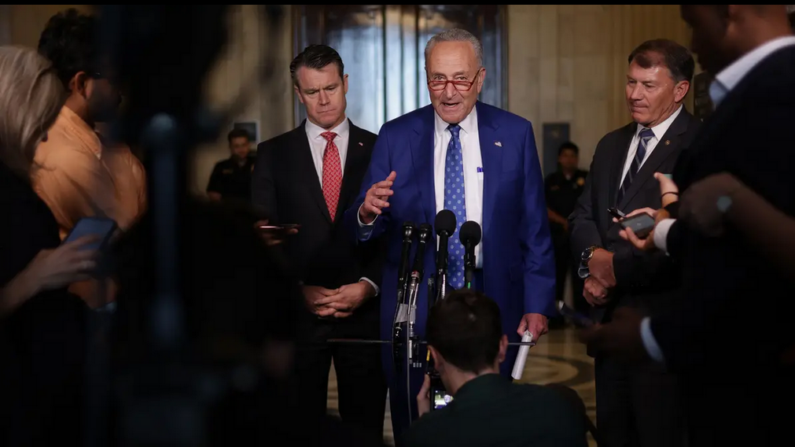

I dirigenti di importanti aziende tecnologiche come X (ex Twitter), Meta, Google e Microsoft hanno incontrato i legislatori all’Ai Insight Forum tenutosi al Senato degli Stati Uniti, che aveva lo scopo di informare il Congresso su come procedere per sviluppare misure di salvaguardia per la regolamentazione delle tecnologie di intelligenza artificiale. Al vertice hanno partecipato oltre 60 senatori. Il leader della maggioranza al Senato Chuck Schumer (Dn.Y.) ha ospitato l’evento, insieme al senatore Mike Rounds, (Rs.D.), Martin Heinrich, (Dn.M.) e Todd Young, (R-Ind.). L’evento è stato un briefing a porte chiuse.

Reuters riporta che Musk (che ha lanciato la sua startup di intelligenza artificiale xAi a luglio) avrebbe spiegato ai giornalisti che «è importante per noi avere un arbitro» per l’Ia. Un regolatore «garantirebbe che le aziende intraprendano azioni sicure e nell’interesse del pubblico in generale».

Il miliardario ha definito l’incontro un «servizio all’umanità», affermando che potrebbe «passare alla storia come molto importante per il futuro della civiltà».

Ha anche confermato che durante il forum ha definito l’intelligenza artificiale un’«arma a doppio taglio».

Nbc riporta che secondo Musk le conseguenze di un’intelligenza artificiale che prenda una brutta strada sono così gravi che l’umanità deve essere «proattiva piuttosto che reattiva. La questione è davvero quella del rischio di civiltà. Non è […] un gruppo di umani contro un altro. È qualcosa che è potenzialmente rischioso per tutti gli esseri umani ovunque. C’è qualche possibilità superiore allo zero che l’intelligenza artificiale ci uccida tutti. Penso che sia bassa. Ma se c’è qualche possibilità, penso che dovremmo considerare anche la fragilità della civiltà umana».

Il Ceo di Meta, Mark Zuckerberg, ha spiegato ai giornalisti che il Congresso dovrebbe «impegnarsi con l’intelligenza artificiale per sostenere l’innovazione e la salvaguardia. Si tratta di una tecnologia emergente, ci sono importanti azioni da bilanciare qui, e il governo ne è in ultima analisi responsabile».

È meglio che «lo standard sia fissato dalle aziende americane che possono collaborare con il nostro governo per regolare questi modelli su questioni importanti».

CNbc riporta che il Ceo di Google Sundar Pichai ha suggerito che ci dovrebbe essere «un maggiore uso dell’intelligenza artificiale nel governo» e ha proposto di portare avanti «un’agenda di transizione della forza lavoro a vantaggio di tutti».

Parlando a Epoch Times, il senatore John Kennedy (R-La.) ha spiegato che «in termini di suggerimenti normativi, non ho sentito molto» ed ha sottolineato che alla riunione sono intervenuti 30 relatori, con solo tre minuti a disposizione per ogni persona. «Abbiamo una sorta di quadro normativo generale su cui siamo vicini a un accordo che affronti i pericoli e il potenziale dell’intelligenza artificiale? A mio giudizio no. Semplicemente non lo facciamo in questo momento».

Kennedy non si aspetta che il Congresso elabori alcuna importante legislazione sulla governance dell’Ia nel prossimo futuro.

Riunione a porte chiuse

Il vertice sull’intelligenza artificiale ha attirato dure critiche da parte dei legislatori, con alcuni membri dei partiti repubblicano e democratico che hanno messo in dubbio la natura a porte chiuse dell’evento in cui ai senatori è stato consentito solo di porre domande scritte e non direttamente a voce agli amministratori delegati del settore tecnologico.

In un’intervista con la Nbc, la senatrice Elizabeth Warren (D-Mass.) ha affermato che «questi miliardari della tecnologia vogliono fare pressione sul Congresso a porte chiuse senza che si possano fare domande. Questo è semplicemente sbagliato. Vogliono modellare la regolamentazione in modo che gli attuali miliardari della tecnologia siano quelli che continuano a dominare e a fare soldi[…] Non dovrebbero avere un forum per farlo, soprattutto un forum a porte chiuse».

Ad Ap il senatore Josh Hawley (R-Mo) aveva comunicato che non avrebbe partecipato a quello che ha definito un «cocktail party gigante per la grande tecnologia». «Non so perché dovremmo invitare tutti i più grandi monopolisti del mondo a venire e dare consigli al Congresso su come aiutarli a fare più soldi e poi nascondersi al pubblico».

Sebbene l’evento si sia svolto a porte chiuse, Schumer afferma che alcuni degli incontri futuri potrebbero essere aperti al pubblico.

Oltre ai massimi dirigenti del settore tecnologico, il panel comprendeva anche stakeholder di gruppi sindacali, creativi e per i diritti civili.

La minaccia dell’intelligenza artificiale

Negli ultimi anni sono aumentate le richieste di rafforzamento della regolamentazione dell’intelligenza artificiale poiché i progressi nelle tecnologie di intelligenza artificiale hanno preoccupato molti esperti per i potenziali rischi.

Durante un’audizione della sottocommissione del Senato a maggio, il senatore Richard Blumenthal (D-Conn.) ha definito lo stato dello sviluppo dell’intelligenza artificiale una «bomba in un negozio di porcellane». La «nuova rivoluzione industriale incombente» potrebbe minare drammaticamente la fiducia nelle istituzioni chiave, secondo Blumenthal.

Durante l’udienza, Sam Altman, Ceo di OpenAi, che ha sviluppato ChatGpt, ha affermato che l’intelligenza artificiale potrebbe destabilizzare notevolmente le società manipolando le elezioni ed eliminando numerosi posti di lavoro: «Abbiamo cercato di essere molto chiari sull’entità dei rischi qui. Dato che dovremo affrontare le elezioni l’anno prossimo[…] penso che una regolamentazione sarebbe piuttosto saggia su questo argomento. […] È una delle mie aree di maggiore preoccupazione».

In un’intervista con Ctv News a luglio, il regista di Hollywood James Camerun, che ha realizzato Terminator quasi quattro decenni fa, ha messo in guardia da una corsa agli armamenti nell’intelligenza artificiale: «Penso che l’utilizzo dell’intelligenza artificiale come arma sia il pericolo più grande. Penso che entreremo nell’equivalente di una corsa agli armamenti nucleari con l’intelligenza artificiale, e se non la costruiamo, gli altri la costruiranno sicuramente, e quindi il rischio aumenterà. Potresti immaginare un’intelligenza artificiale in un teatro di combattimento, il tutto combattuto dai computer a una velocità a cui gli umani non possono più intervenire e non hai la capacità di allentare l’escalation».

Nel frattempo, all’inizio di questo mese, i senatori Hawley e Blumenthal hanno annunciato un quadro bipartisan per la legislazione sull’intelligenza artificiale che cerca di stabilire «guardrail» per la tecnologia dell’intelligenza artificiale.

Il quadro mira a stabilire requisiti di licenza per le aziende che sviluppano sofisticati modelli di intelligenza artificiale per scopi generali. Tali società dovrebbero registrarsi presso un organismo di controllo indipendente.

Articolo in inglese: American Tech CEOs Converge in Senate Event Calling for AI Regulation